豆包深度思考模型正式发布!和 o3 一样能「看图思考」,还有一个 Agent 大招

这两个月,AI 模型和产品的发布节奏用「日新月异」都不足以形容了。

GPT-4o 生图的爆火似乎还是昨天,OpenAI 放出了自家最强推理模型 o3 和 o4 mini,但可能这还不是这个月最重磅的 AI 发布,DeepSeek R2、Anthropic 的 Claude 4 以及马斯克剧透的「Grok-3.5」 ,极有可能将在本月陆续发布。

而且就在今天,字节还发布了一整套 AI 全家桶,深度思考模型、视觉推理、文生图、AI Agent……几乎涵盖了最近 AI 圈关注度最高的产品。

先看看这次字节发布的产品和亮点有哪些:

1. 豆包 1.5 · 深度思考模型

- 推理能力跻身全球第一梯队

- 更低延迟支撑高要求应用

- 多模态理解与应用场景:支持「边想边搜」和「视觉推理」

2. 文生图 3.0

- 3 秒出图

- 原生 2K 高清

- 文本排版与小字生成优化

- 美感效果和生图结构提升

3. 豆包 1.5 视觉理解模型新版

- 视觉定位更精准

- 对视频的理解更智能

4. AI Agent

- 垂类应用 Agent:豆包推出了国内首个 AI IDE——Trae

- OS Agent:能够操作浏览器、电脑、手机或其他 Agent 完成复杂任务

字节这一系列产品升级,不仅在推理能力和多模态理解上实现突破,也通过 Agent 加速 AI 在更多场景的应用落地。

就像火山引擎总裁谭待所说的,「如果说 2024 年是中国AI应用的元年,那 2025 年极有可能是 AI Agent 应用的元年。」

豆包 1.5·深度思考模型:「边想边搜」+「视觉推理」,像人一样思考和观察

豆包 1.5·深度思考模型作为本次升级的核心,有三个关键升级:更强的推理效果、极低的响应延迟和全面的多模态能力。

在专业领域推理能力测试中,豆包深度思考模型整体达到或接近全球第一梯队水平。

- 数学推理方面,在 AIME 2024 测试中的得分已追平 OpenAI o3-mini-high。

- 编程竞赛方面,在 Codeforces pass@8 测试中接近 OpenAI o1。

- 科学推理能力在 GPQA 测试中也接近 o3-mini。

豆包 1.5 深度思考模型采用总参数达 200B 的 MoE 架构,但激活参数仅为 20B。

这种设计可以在保证强大性能的同时,显著降低了训练和推理成本,实现了 20 毫秒的极低延迟,这意味着能更好应用在对延迟敏感的实时交互场景。

豆包深度思考模型技术报告 🔗

https://github.com/ByteDance-Seed/Seed-Thinking-v1.5

在实际体验中,豆包深度思考模型的「边想边搜」和「视觉推理」这两个功能,带来了一些惊喜,也是目前相较同类产品比较有特色的。

「边想边搜」功能模拟了人类解决问题时边思考边查阅资料的过程,,它把搜索和推理捆绑在一起,基于每一步的思考结果进行多次搜索,能让回答更有逻辑、更贴近需求。

APPSO 不久前对豆包深度思考的「边想边搜」也进行了详细体验。

以购物推荐场景为例,用户需要为一家三口选择露营装备,涉及预算、安全性、便携性、适应天气等多维度因素。

豆包深度思考模型不是简单给出答案,而是像顾问一样进行多轮搜索和思考:

- 1. 第一轮搜索价格与性能数据,确定基本选择范围

- 2. 第二轮针对儿童需求搜索,筛选安全适合的装备

- 3. 第三轮考虑天气因素,查询详细评测

整个过程透明化,用户可以看到模型如何一步步构建解决方案。这种「边想边搜」能力不仅适用于购物决策,还能应用于金融分析、旅游规划等复杂决策场景。

至于豆包 1.5 深度思考模型的视觉推理能力,刚好和 OpenAI o3 不谋而合,让 AI 能像人类一样基于图像进行深层思考。

比如在地理位置推测任务中,模型不仅识别出图片中的湖泊,还注意到湖泊边缘的盐结晶和周边旅游设施等微小细节,通过逻辑推理精确定位景点位置。

而在国外点餐场景更具代表性,模型需要同时处理多种复杂因素:计算不同货币的价格换算、考虑老人和儿童的饮食喜好、避开可能引起过敏的食材等。这种能力大大超越了传统的单一功能工具。

视觉推理能力在企业办公场景其实也能发挥重要作用,豆包可以解读复杂的项目管理流程图表,快速定位关键信息,严格按照流程图逻辑回答问题。

可以看到,无论是解析财报图表还是分析产品说明图,都能展现专业水准的理解能力。

豆包文生图 3.0:从生成到创造的飞跃

Gemini 2.0 和 GPT-4o 的「一句话生图」掀起了新一轮生图的热潮,这次豆包文生图模型 Seedream3.0 则在三个核心方面实现突破:文字排版、图像真实感和高清输出能力。

在文生图领域权威评测 Artificial Analysis 竞技场中,豆包文生图 3.0 已经不输 GPT-4o、Imagen 3、Midjourney v6.1、FLUX 1.1 Pro 等顶级模型,跻身全球第一梯队。

Seedream3.0 最显著的升级是实现了 2K 分辨率图像的直接生成。字节技术团队通过多分辨率混合训练策略,让模型能够适应从手机屏幕到巨幅海报的各种比例需求,无需后期放大处理即可输出清晰高质的图像。

这种原生高分辨率能力,意味着对专业设计和商业应用提供了极大便利。

同时 1K 分辨率出图缩小到 3 秒,这一高效推理能力得益于多项技术优化,让创作者能够实现「所想即所得」的实时交互体验。对于海报设计、视觉创意这类需要和甲方高效沟通的场景。这种速度就很实用。

中文小字和长文本排版一直是 AI 绘画痛点,豆包 3.0 不仅解决了这一难题,还将排版美感提升到专业水准。以「现形」海报系列为例,生成内容细节丰富、排版精美,达到了商用水平。

人像生成方面,通过缺陷感知数据优化和跨模态编码技术,新模型在皮肤质感、表情自然度、服装纹理等方面极为逼真,几乎消除了 AI 生成的「诡异感」。

目前 Seedream3.0 已在豆包、即梦等平台全量开放,大家不妨亲自试玩。

视觉理解模型:从识别到理解

豆包 1.5·视觉理解模型主要在视觉定位和视频理解两个方向实现了突破。

视觉定位方面,新模型支持多目标定位(同时识别多个物体)、小目标定位(识别极小物体)和通用目标定位(不受预训练类别限制)等高级功能,还能进行点定位计数和 3D 场景定位。这些能力为机器人视觉、自动驾驶等领域提供了坚实基础。

同时,模型实现了记忆能力增强、总结理解能力提升、速度感知能力和长视频理解能力的全面提升。这使得用户可以对家庭监控视频进行语义搜索,如询问「今天小猫在家都干什么了?」系统能定位并展示相关片段。

AI Agent 的未来:应用 + OS

这次豆包 1.5 的核心突破不仅体现在模型能力上,更重要的是为 AI Agent 提供了强大基础,开始思考「AI 该解决什么问题」,而非单纯追求技术指标。

谭待认为, AI Agent 的构成,可以分为垂类应用 Agent 和 OS Agent。

在应用 Agent 领域,豆包团队推出了针对不同垂类场景的专业 AI 助手,包括客服 Agent、数据 Agent 和代码 Agent 等。这些 Agent 专注于特定领域任务,具备深度专业能力。

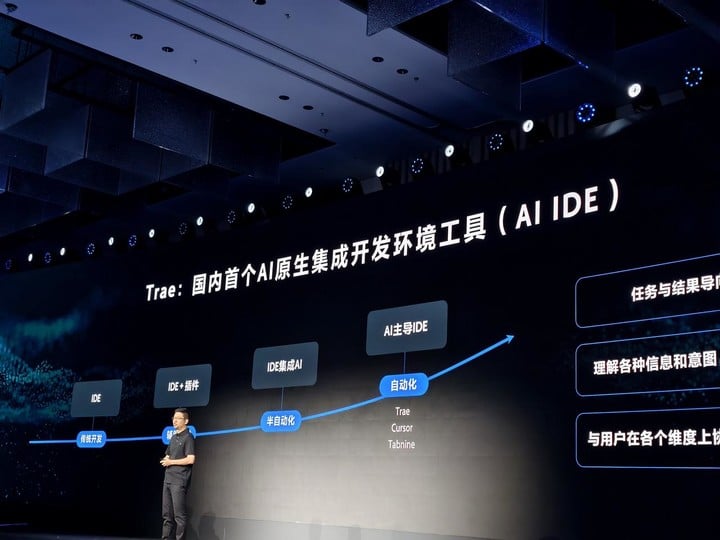

其中最引人注目的是国内首个 AI IDE——Trae。与传统 AI 插件不同,Trae 将 AI 与集成开发环境深度融合,具备三大核心特质:

- 交付化:面向软件交付而非仅生成代码,从本质需求出发

- 智能化:能理解信息和意图,自主规划反思,调用工具执行任务

- 协作化:能与用户在多个维度协作,保障最终结果质量

这种设计理念使 Trae 能帮助开发者和企业更快速、更准确地完成软件开发工作,实现从代码片段生成到完整软件交付的跨越。

而 OS Agent 代表了 AI 能力的更高层次——拥有跨场景的通用性和灵活性,能够操作浏览器、电脑、手机或其他 Agent 完成复杂任务。

火山引擎的 OS Agent 解决方案核心由豆包大模型和 veFaaS 产品组成。通过两个案例可以直观了解其强大能力:

在更复杂场景中,OS Agent 甚至能操作专业软件。如使用剪映专业版进行视频剪辑和配乐,或通过豆包 APP 生成内容并发布至今日头条;在手机端,则能操作指定 APP 完成高铁订票等任务。

这些能力的核心是全新发布的 GUI Agent 大模型——UI-Tars,它将屏幕视觉理解、逻辑推理、界面元素定位和操作整合在单一模型中,突破了传统自动化工具依赖预设规则的局限。UI-Tars 在 OS World 等测试集中已取得国内各类模型中的最优成绩。

最近 OpenAI 姚顺雨在一篇文章中指出,我们已经进入了AI 发展的「下半场」。与上半场不同,下半场不再仅关注模型改进和技术指标,而是转向如何定义真正有价值的问题以及如何衡量真正的进步。

很难说在 AI 迅猛而又非线性的发展,用过去互联网的上下半场来划分是否适用,但一些转变确实在发生:不再把模型作为目的,而是作为解决实际问题的工具。

这可能就是字节内部所谓「务实的浪漫」,字节 CEO 梁汝波在年初的字节 All Hands 全员会上强调了这个概念。

这是最初是张一鸣在 2019 年提出的,他认为务实的浪漫就是 「把想象变成现实,face reality and change it。」

面对 DeepSeek 和 Agent 产品带来的 AI 行业剧变,这也会是字节的应对方式。