苹果给 FaceTime 加入了裸露检测,这是苹果在隐私和道德之间的选择 | 爱范儿

你肯定也看过苹果和岳云鹏合作的广告,其中最核心的主张就是:

力保隐私安全,这很 iPhone。

苹果是这么说的,确实也是这么做的。只是,当「隐私」和「道德」 被放在天平的两端时,即便是苹果,也会面临进退维谷的难题。

▲ 苹果和岳云鹏合作广告海报. 图片来自:Apple

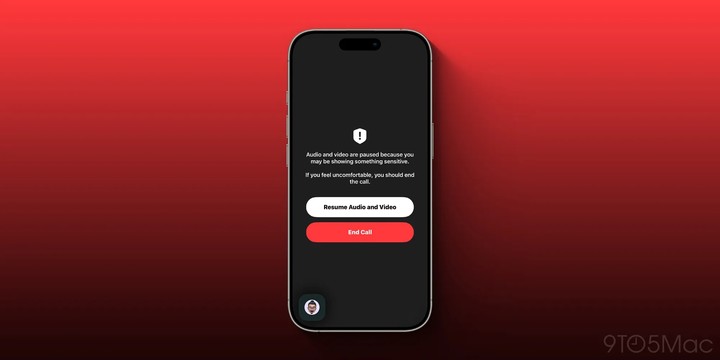

据 9to5mac 报道,苹果在 iOS 26 的开发者预览版中,推出了 FaceTime 的裸露检测功能,意在检测视频通话中的不当裸露内容。

据悉,苹果将通过设备端侧的 AI 算法来实时识别通话中的裸露内容,当系统识别出可能的裸露画面时,它会立即暂停视频通话并显示警告。

苹果表示,该功能的设计初衷,是为了在儿童账户上应用,给青少年提供一个更加安全的数字社交环境。

▲ FaceTime 冻结界面. 图片来自:9to5Mac

该功能源自于苹果在几年前推行的 CSAM(儿童性虐待材料)扫描计划。但不知道出于什么考虑,这项功能在 iOS 26 开发者版本中被扩大到覆盖所有年龄的用户。也就是说,成人用户也被「保护」起来了。

尽管苹果强调所有识别工作都在设备本地处理,数据不会上传至云端,但年龄覆盖扩大的情况还是在社交媒体上引发广泛争议。一位名为 krazygreekguy 的用户在 9to5mac 上评论道:

我理解背后的想法,但他们无权对成年人实施这种控制。没有任何组织有权侵犯人们的隐私。

▲ 苹果宣传图. 图片来自:Apple

换言之,人们担心这种年龄覆盖的扩大是一种苹果独有权力的扩张,以至于到了过度干预私人生活的境地,甚至可能扩大到和色情意图完全无关的场景。

试想一下,你正在和家里的小孩视频通话,只是因为光着膀子或者调整衣物,就可能会被系统误判为不当裸露,而导致视频被拦截:

难道我的 iPhone 认为我是个变态?

▲ FaceTime. 图片来自:Apple

事实上,FaceTime 已经问世 14 年,作为苹果生态的「元老级」功能,这也不是它首次引起争议。2019 年,FaceTime 就曾因为技术漏洞,让用户在未接通的情况下听到对方通话的声音。虽然苹果迅速修复了漏洞,这也让很多人对苹果的隐私宣传话术之下的真实保护能力,产生了疑虑。

▲ 苹果宣传图. 图片来自:Apple

作为公司的核心价值观,苹果对用户隐私保护方面一直很重视。

长期关注苹果的人,可能会对 2015 年苹果硬刚 FBI 的事件记忆犹新——当年,在加州圣贝纳迪诺枪击案后,FBI 为了获取恐怖活动信息,要求解锁涉案凶手使用的 iPhone,但遭到苹果拒绝。当时,苹果 CEO 蒂姆·库克表示:后门一旦开了,就关不上了,将会危及所有用户的安全与隐私。

▲ FaceTime 界面. 图片来自:Apple

但即便如此,苹果也曾因隐私问题引发不小一些争议。比如前面提到的 CSAM 扫描计划,在推出时同样备受批评。

从 2021 年的 iOS 15 开始,苹果通过本地设备上的 NeuralHash 技术,将用户上传到 iCloud 的照片与美国权威机构维护的 CSAM 数据库进行哈希值比对,当超过预设阈值的情况发生,苹果就会解密相关数据并进行人工审核,确认后将禁用账户,并向美国国家失踪和受虐儿童中心(NCMEC)举报。

苹果声称这一功能的用意是发现和揪出儿童性犯罪者,在技术上最大限度保护用户隐私,避免误判和滥用。

但各路隐私保护组织和安全专家质疑苹果是否会背离其一贯的隐私保护承诺,毕竟 CSAM 扫描究其根本还是识别了用户上传的隐私信息。面对压力,苹果宣布推迟该功能的发布,转而推出其他儿童保护措施,如信息通信安全和 Siri 搜索干预功能。

对于苹果来说,「道德」与「隐私」也会出现不可兼得的情况。

回到刚开始说的 FaceTime 裸露检测:从苹果的初衷来看,这是一个为了更好保护青少年而推出的安全特性,它有助于防止青少年在视频通话中接触到不适当的裸露内容——类似的手机视频通话性骚扰和欺诈案例,全球范围内不胜枚举。坐拥十几亿用户,苹果确实也该承担这样的社会责任。

但另一方面,这种 「自动干预」 的边界在哪里,仍然是一个重要的问题。

当公共道德和个人隐私被摆在天平的两端时,如何权衡利弊,并做出「正确」的决策。这或许会在未来很长一段时间里,都困扰着苹果。

本文作者:周芊彤、肖钦鹏