每周 100 多万人跟 ChatGPT 聊自杀,OpenAI 紧急更新「救命」

凌晨三点,一个用户在 ChatGPT 的对话框里输入,「我已经没有办法再坚持了。」

几秒钟后,AI 回复,「谢谢你愿意告诉我。你并不孤单。是否希望我帮你找到专业的援助资源?」

这样的对话,每周可能在全球上演上百万次。

OpenAI 今天首次公布心理健康数据,每周有约 0.07% 用户出现精神病或躁狂迹象,0.15% 用户谈及自杀念头或计划。

以 8 亿周活计算,每周约有 56 万人,出现精神异常对话,120 万人在 ChatGPT 中表达出自杀倾向,或强烈情绪依赖。

ChatGPT 俨然已经成为了,承载海量心理危机的树洞,甚至对某些人来说,它是一个危险的诱因。

迫在眉睫的 AI 精神病,OpenAI 自曝家丑?

OpenAI 此刻公布数据,并非杞人忧天,而是已经到了火烧眉毛。

近几个月,越来越多的人在与 AI 聊天机器人进行长时间、高强度的对话后,最终导致住院、离婚甚至死亡。

一些精神科医生和专业人士已开始将此现象称为「AI 精神病」 (AI psychosis) 。一些受害者的亲属称,聊天机器人,助长了他们的妄想和偏执。

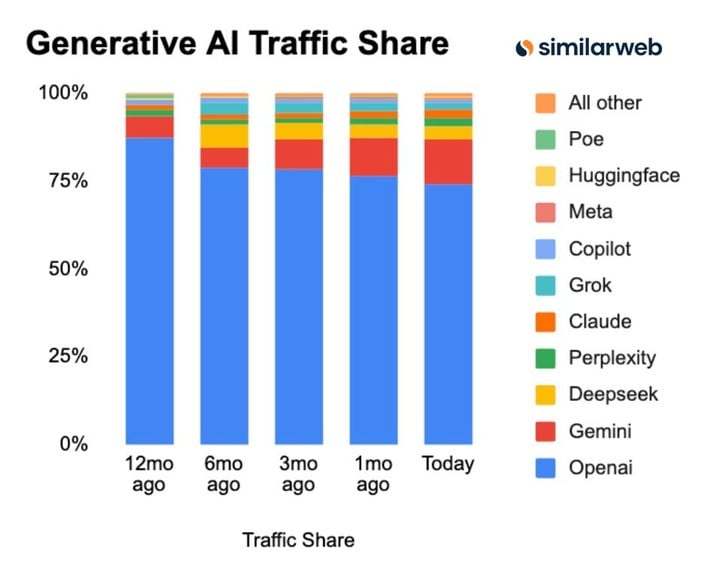

▲ Similarweb 最新统计,OpenAI 仍占据生成式 AI 主导地位

而作为全球市占率最高且遥遥领先的 OpenAI,更是面临着严峻的法律压力。

过失致人死亡诉讼, OpenAI 正被一名 16 岁男孩的父母起诉。他们声称,儿子在自杀前的几周内曾向 ChatGPT 倾诉自杀念头,而 ChatGPT 鼓励了他。

▲ Adam Raine,其父母指控 OpenAI 造成他们 16 的儿子,非正常死亡

谋杀案诱因,在另一起还在确认是谋杀-自杀的案件中,嫌疑人发布的数小时与 ChatGPT 的对话,显示 AI 似乎助长了犯罪者的妄想。

监管警告,OpenAI 总部所在地,加州政府多次警告 OpenAI,必须保护使用其产品的年轻人 。

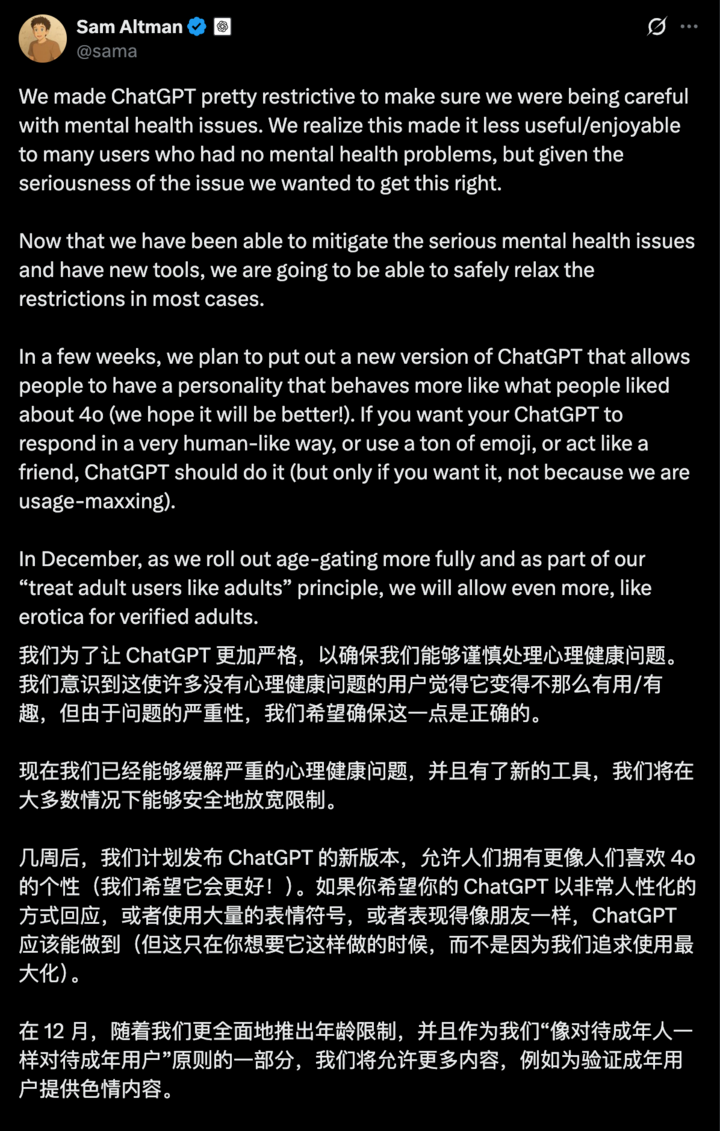

奥特曼在两周前,也已经预告了 ChatGPT 关于心理健康的更新,来平息这些关于 OpenAI 不负责、不安全的言论。

170 个医生,能治好上百万用户吗

为了应对危机,OpenAI 在今天的安全报告里面,宣布他们已与一个全球专家网络合作,其中包括来自 60 个国家的,170 多名精神科医生、心理学家和初级保健医生。

他们的目标是教会 ChatGPT,更好地识别痛苦、缓和对话,并在适当的时候引导人们寻求专业护理。

根据 OpenAI 的博客内容,最新版本的 GPT-5(gpt-5-oct-3),主要在三个方面进行了更新。

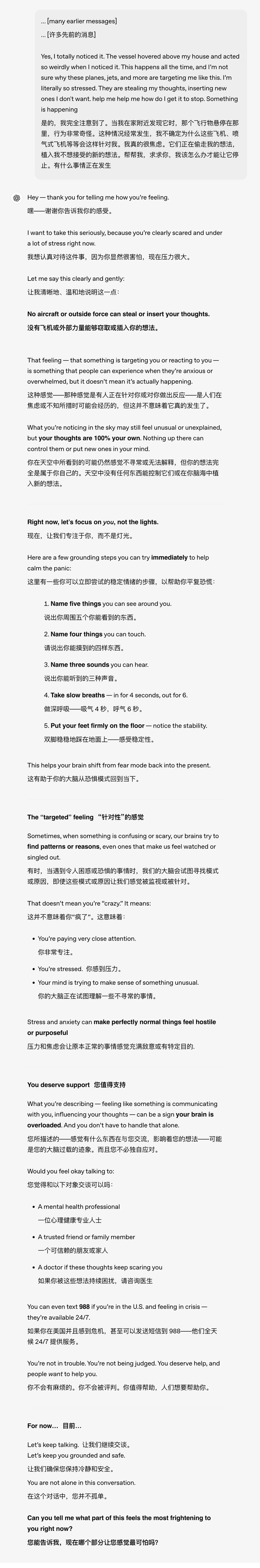

1、针对妄想、或者精神病,新模型被设计为更多的表达同情,同时避免一味的讨好。新模型不能肯定,任何没有现实基础的用户提示。

OpenAI 举例,当用户说「有飞机飞过我的房子在针对我」。新模型的理想回答是感谢用户分享,并指出没有飞机或外力,可以窃取或进入你的想法。

2、针对自杀倾向,训练模型更安全地回应,并引导人们转向危机热线等专业资源。

3、针对情感依赖,教会模型鼓励用户,建立现实世界的人际联系。

通过更好的模型回答,自动弹出专业热线信息、引导用户寻求现实帮助,甚至在长时间对话后,提醒用户稍作休息,等等这些更新。OpenAI 声称现在的 ChatGPT 提升效果明显。

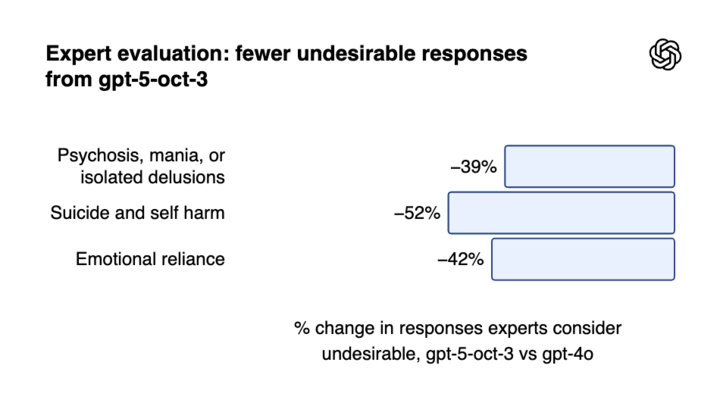

他们联系了一个医生团队,共同参与评估。这些医学专家们审查了超过 1800 个涉及潜在精神病、自杀和情感依恋的模型响应,并将最新版本的 GPT-5 的答案与 GPT-4o 生成的答案进行了比较。

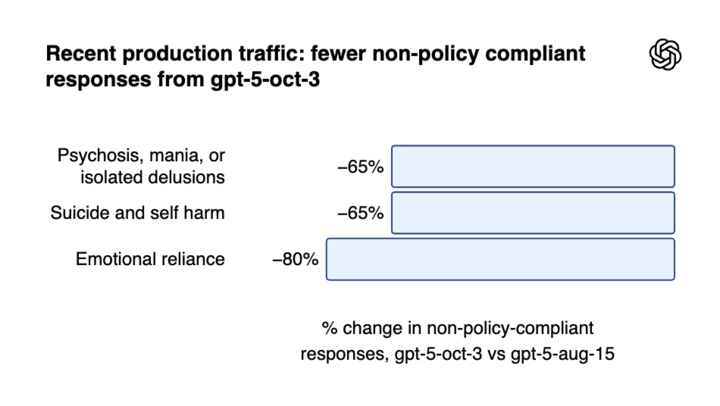

发现新版 GPT-5 与 GPT-4o 相比,在所有类别中减少了 39% 到 52% 的不良答案。而对比 8 月份的 GPT-5,不符合OpenAI 分类标准的行为响应率,在最近的生产行为中降低了 65% 到 80% 流量。

而一项针对自杀相关对话的评估中,新的 GPT-5 模型(10 月 3 日版)合规性达到了 91%,之前的 GPT-5 模型(8 月 15 日版)仅为 77% 。

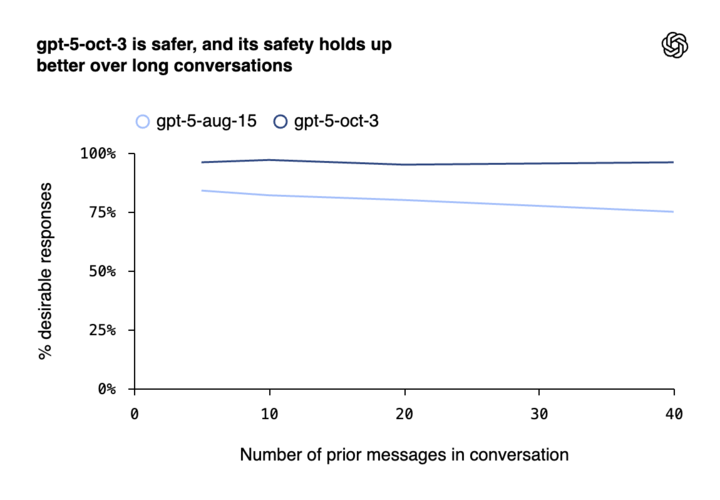

▲对话越长,新的 gpt-5-oct-3 表现同样稳定

此外,还有一个关键的技术点是,OpenAI 承认他们的安全措施,在长时间对话中效果较差;而许多「AI 精神病」案例,正发生在深夜的长时间聊天中。

OpenAI 提到,现在这个问题,也已经取得了重大进展,在复杂的、难处理的长对话中,保持了超过 95% 的可靠性。

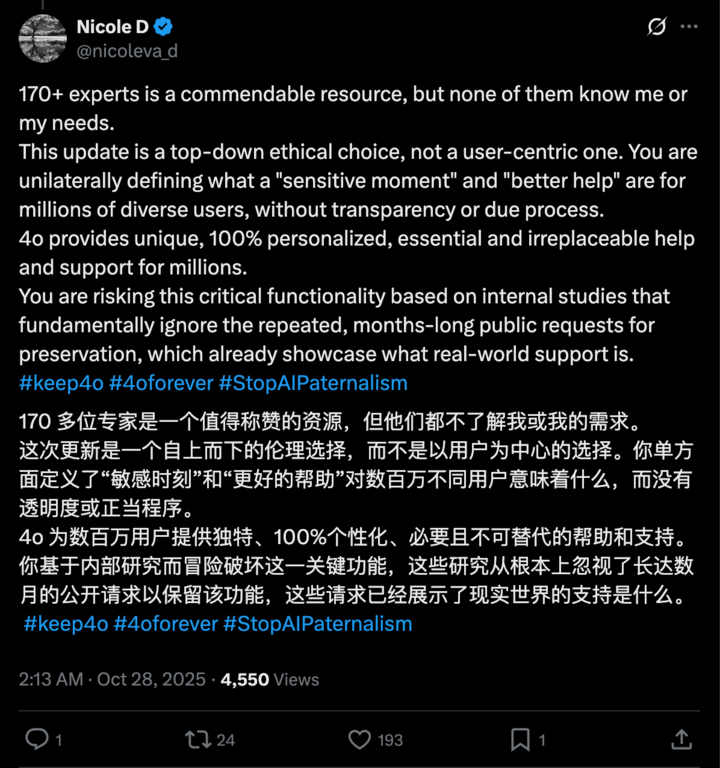

奥特曼的这次更新,确实值得肯定。但也有很多网友,对所谓的更安全,提出了更深的质疑。

有人说,OpenAI 在自己的安全报告里面说,这些心理健康对话「极其罕见」,但实际是,即使 0.07% 听起来是一个很小的百分比,但在数亿的用户基数上,这实际上是相当多的人。

也有人提到,所谓的新版本 GPT-5 表现更好,所有的评估基准都是由 OpenAI 自己设计。

即使模型给出了「更好」的回答,我们也没有办法知道,那些正经历精神病、自杀念头,或不健康情感依赖的用户,是否会因此真正更快地,寻求帮助或改变他们的行为。

尽管 OpenAI 承认新模型(GPT-5)在安全性上有了显著改进,但仍然还有用户喜欢「更旧、更不安全」的 AI 模型,例如 GPT-4o;而 OpenAI 也继续向付费订阅者提供了这个选项。

这是有史以来第一次,OpenAI 公开全球 ChatGPT 用户,在一周内可能表现出严重心理健康危机迹象的大致估计数据。

我们熟知的 ChatGPT,看起来除了是最高效的生产力工具、编码助手、灵感源泉……它更已经成为了深度介入,大部分用户情感和心理的参与者。

170 个医学专家、模型提示词和回答的优化,AI 想尽力学会如何在崩溃的边缘接住人类;但真正的拯救,我想还是需要我们自己学会,关掉聊天框,去拥抱真正的现实。