只把 20 世纪前的物理数学知识喂给 AI,AI 能推导出狭义或广义相对论吗?

绝对不会。因为达到这一步,就达到了 AGI。这是戴爵的 AGI 标准,也是 AGI 标准中最苛刻的。

今年五月份《经济学人》大总管 Zanny Minton Beddoes 采访了戴爵和小卷毛 Dario Amodei。

戴爵提到了:爱因斯坦只使用了他所在时代的知识就完成了广义相对论的论证……(我们的 AI)要具备这种能力恐怕还要花更长时间。

戴爵给出了模糊的试问:目前的范式(transformer LLM 为主导的 AI)是否能在达到一定的训练量是出现这种能力。

我在五月份的文章《爱因斯坦的飞跃》里,也是沿着戴爵的思路去思辨探索的,但我想否定掉我之前对"数据量不足"的假设。

因为这是一个 Agency 问题,不是数据问题。

——

我想给出一些尝试性思辨探索。这是一次探索,只能保证与现有现象不冲突,且逻辑尽量自洽,但不保证结论为真。

① 数据没有引发质变

我们并没有在 Opus,Llama 405,GPT-4.5,Gemini 2.x 这些表达模型中观察到 模型发现"新知识"的迹象。 尤其是 Gemini 2.x 作为最新一代的巨模,它的数据量已经达到了前所未有的程度,满足了巨型参数 + 巨量数据的融合。

② 新功能 来自新的"填鸭补充"

但从我近五个月高强度的尝试。我并没有发现它有超出数据之外的表现力,它只是对旧知识旧数据的更好,更丝滑的拟合。它可以确保文章下一个词是用得最到位最贴切的,仅此而已。像 Gemini 2.5 Pro Deep Think 一些新特性比如冲击 IMO 金牌,对 SVG 视觉更好的呈现是后来通过 Task Specific Fine tuning 加入的特性。模型没有"自悟"出这些能力。

③ 接下来,是暴论环节。

困死在山谷里的数学宿命

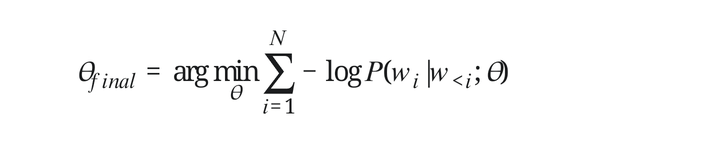

我认为一个模型训练完成,Loss Function 最小化,达到 The End of Gradient Descent,它就变成了一种"inference 语言机",我在这里强调的是"机",而不是 AI,是希望读者不要带入幻想。

一个 input 放进"语言机"在末端给出一个最合理的 output。这是一个有万亿形状各异的齿轮咬合在一起的旧世界规则机,这个输出是符合"旧世界秩序"的输出,它是一个极端的保守派。

如果,爱因斯坦的广义相对论未被直接嵌在这个模型的表征空间中,那么,它其实是个"错误"。这只是一个例子,所有外推的结论都会被模型视为一种"错误",一种由于概率过低而被视为错误的陈述。

——这就要回到模型是如何判定事实为真的?这是翻译机时代一种理念,一个词出现的概率越大,那么被视为"真"的概率就越大。就是这样,这是所有"语言机"的本质特征。

LLM 的梯度下降优化过程,本质上是让模型"沉降"到数据流形的最深处(Loss Function 的最低点),任何试图爬出这个流形的探索都会受到损失函数增大的惩罚,因此,它是一个极端的“保守派”,是其数学宿命。

④爱因斯坦的飞跃——"终点视觉"和 Agency

爱因斯坦为什么可以靠黎曼几何,张量分析,微分几何等已有知识就可以完成广义相对论的论证?

其实也很简单,因为人类和语言机是不同——人有对奖励的渴望(解决牛顿引力与狭义相对论之间的矛盾),主动的探索思辨,反复的批判修正,对工具的熟练运用。

还有一个点,最关键的是,爱因斯坦实际上已经看到了终点,只是在寻找通向终点的路径。

这似乎是人类特有特质,对新图景的反事实推理和想象力。 模型也有想象力,这件事 Anthropic 在博客文章中提到过,但那种想象力只是对结果的一个预估,而这个结果已存在于旧世界中。模型无法主动设想存在于一个系统之外的广义相对论,然后找到路径论证它。

爱因斯坦的飞跃,我想,最重要的是,他已经"看到"了终点,一个能够统一引力和时空的新图景,他是在这个"终点视觉"的指引下,去寻找通向它的数学路径(黎曼几何等工具)。这才是问题所在,我们几乎没有技术可以为模型植入"终点视觉",我们可以为模型设定一个答案为可以形式化的终点,比如在 11 维空间中接吻数>592,让 AlphaEvolve 去试错探索,但我们如何描述"牛顿引力和狭义相对论统一的图景感?"

⑤ 我有仔细听 GPT-4.5 的项目后分析。有位研究员说:现在的学习方式需要得到非常大的革新。未来我们可能要在原有的数据上取得一种突破。

我想我们需要一套新的学习方法,可能叫做 Agentic Learning,让 AI 在学习的阶段就进行一种自主性的探索。而不是用一个预训练模型,再打磨成一个 Agent,这两者的性质在神经网络上的投射是不同的。

这会带来极大的对齐和安全问题。——不过,我在想这就是异端和危险思想的魅力,我们可能未来不能既要安全对齐,又能超凡脱俗。

When Einstein put forward the theory of general relativity, he based it on the information available to him at that time. To give another example, can we invent a game like Go? Not just making a brilliant move (such as move 37), nor developing something like AlphaGo that can beat world champions, but truly inventing a game as aesthetically pleasing as Go. I think it will take much longer to acquire such a capability.

爱因斯坦提出广义相对论的时候,也是基于他当时能掌握的信息。再举个例子,咱们能发明出像围棋这样的游戏吗?不是说下出什么妙手(比如第 37 手那种),也不是搞出阿尔法狗这种能打败世界冠军的东西,而是真的发明一个和围棋一样有美感的游戏。我觉得要具备这种能力,恐怕还得花更久的时间呢。